Hadoop培训教程:HDFS文件存取机制

Hadoop培训教程:HDFS文件存取机制,一个分布式文件系统最基本的功能就是读和写,本节将描述HDFS的文件存取机制。

1.HDFS读文件数据流

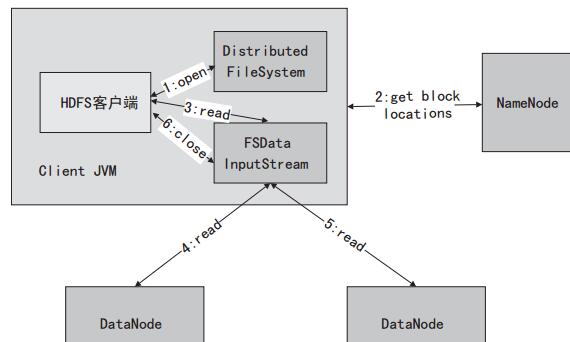

在读取HDFS的文件时,首先客户端调用FileSystem的open( )函数打开文件,DistributedFileSystem用RPC调用元数据节点,得到文件的数据块信息。对于每一个数据块,元数据节点返回保存数据块的数据节点的地址。DistributedFileSystem返回FSDataInputStream给客户端,用来读取数据。客户端调用stream的read()函数开始读取数据。DFSInputStream连接保存此文件第一个数据块的最近的数据节点。Data从数据节点读到客户端,当此数据块读取完毕时,DFSInputStream关闭和此数据节点的连接,然后连接此文件下一个数据块的最近的数据节点。当客户端读取完数据的时候,调用FSDataInputStream的close函数。客户端读取HDFS中的文件访问数据流的整个过程如图3-3所示。

图中的操作序号1、2、3、4、5表示执行顺序,读取文件的数据流步骤如下:

1)调用FileSystem的open()打开文件,见序号1:open。

2)DistributedFileSystem使用RPC调用NameNode,得到文件的数据块元数据信息,并返回FSDataInputStream给客户端,见序号2:get block locations。

3)HDFS客户端调用stream的read()函数开始读取数据,见序号3:read。

4)调用FSDataInputStream直接从DataNode获取文件数据块,见序号4、5:read。

5)读完文件时,调用FSDataInputStream的close函数,见序号6:close。

2.HDFS写文件数据流

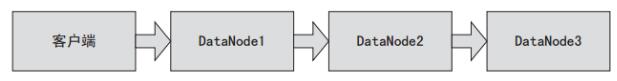

HDFS的写文件数据操作,比读文件数据复杂一些。读文件数据的时候,只需要在多个数据块文件中选一个读就可以了,但是,写文件数据需要同时写到多个数据块文件中,这就相对比较复杂了。HDFS的写机制可以通过图3-4进行简单描述。

如图所描述,数据流从客户端开始,流经一系列的数据节点,到达最后一个DataNode。图3-4中的所有DataNode只需要写一次硬盘,DataNode1和DataNode2会从socket上接收到数据,将它直接写到下个节点的socket上。需要注意的是,如果当前DataNode处于数据流的中间,那么该数据包会被发送到下一个节点。接下来就是处理数据和校验,并分别将数据包写到数据块文件和数据块元数据文件中。如果出错,抛出的异常会导致receiveBlock关闭相关的输出流,并终止传输。同时,数据校验出错还会上报到NameNode上。

最后一个DataNode由于没有后续节点,PacketResponder的ackQueue每收到一项,表明对应的数据块已经处理完毕,那么就可以发送成功应答。如果该应答是最后一个包的,PacketResponder会关闭相关的输出流并提交。如果DataNode有后续节点,那么,它必须等到后续节点成功应答才可以发送应答。

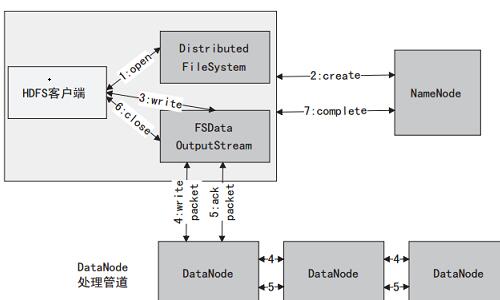

上面描述了HDFS在写文件数据时的基本处理机制,从客户端开始,直到在HDFS上完成写一个文件的整体数据流程图如图3-5所示。

正如图所示,首先客户端调用create()来创建文件,然后DistributedFileSystem同样使用RPC调用NameNode元数据节点,在文件系统的命名空间中创建一个新的文件。NameNode首先确定文件原来不存在,以及客户端有创建文件的权限,然后创建新文件。

DistributedFileSystem返回DFSOutputStream,客户端用于写数据。客户端开始写入数据,DFSOutputStream将数据分成块,写入Data Queue。Data Queue由Data Streamer读取,并通知元数据节点分配数据节点,用来存储数据块(每块默认复制3块)。分配的数据节点放在一个pipeline里。Data Streamer将数据块写入pipeline中的第一个数据节点。第一个数据节点将数据块发送给第二个数据节点,第二个数据节点将数据发送给第三个数据节点。DFSOutputStream为发出去的数据块保存了Ack Queue,等待pipeline中的数据节点告知数据已经写入成功。如果数据节点在写入的过程中失败,则关闭pipeline,同时将Ack Queue中的数据块放入Data Queue的开始位置。

-

标签错误:<!-- #Label#

labelId=20160707140604

moduleId=1

classId=12231768634

orderby=2

fields=url,title,u_info

attribute=

datatypeId=22192428132

recordCount=3

pageSize=

<htmlTemplate><dt><img src="/images/index_26${index}.jpg" width="100" height="62" /><a href="$url" title="${title}">${title}</a><span>${api.left(u_info,60)}</span></dt></htmlTemplate>

-->

- 我要参加技术沙龙